ChatGPT Images 2.0 は、OpenAI が 2026 年 4 月 21 日に正式発表した、テキスト描画精度約 99% と推論モードを備える次世代の画像生成モデルです。

📖 この記事で分かること

- OpenAIが2026年4月21日に新モデルを正式リリース

- テキスト描画精度が約99%に向上し日本語にも対応

- 「考えてから生成する」推論モードを初搭載

- 全ユーザー無料開放、APIではgpt-image-2として利用可能

💡 知っておきたい用語

- 推論モード(シンキングモード):生成前に構成やレイアウトを「考える」処理ステップ。レストランの厨房が料理を出す前に盛り付けを頭でイメージするように、指示に沿った精度の高い画像を生成します。

最終更新日: 2026年5月21日

ChatGPT Images 2.0とは何か

OpenAIが2026年4月21日、次世代の画像生成モデル「ChatGPT Images 2.0」を正式発表しました。基盤モデルはAPI上でgpt-image-2として提供され、ChatGPT・Codex・APIのすべてで利用可能です。

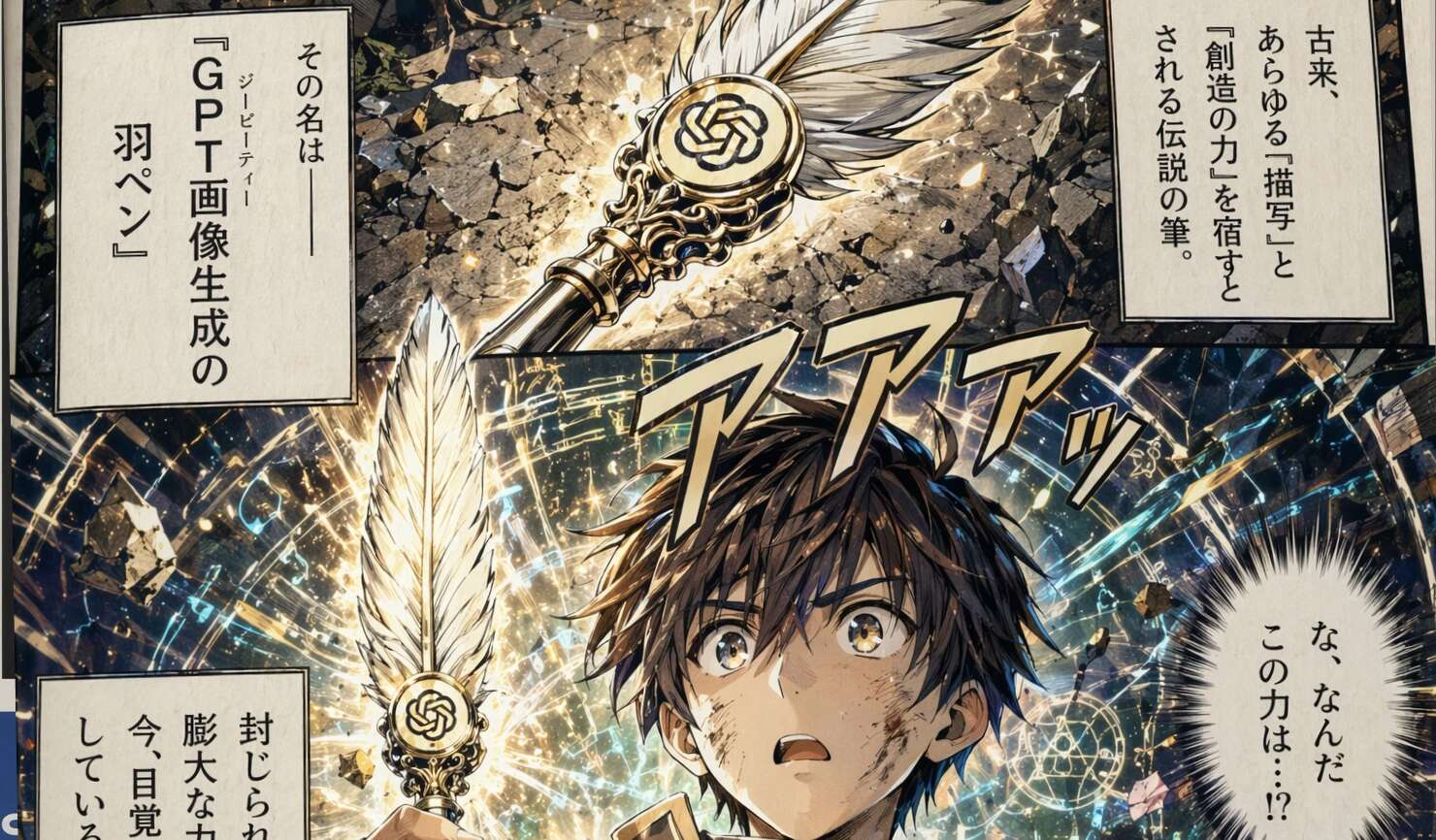

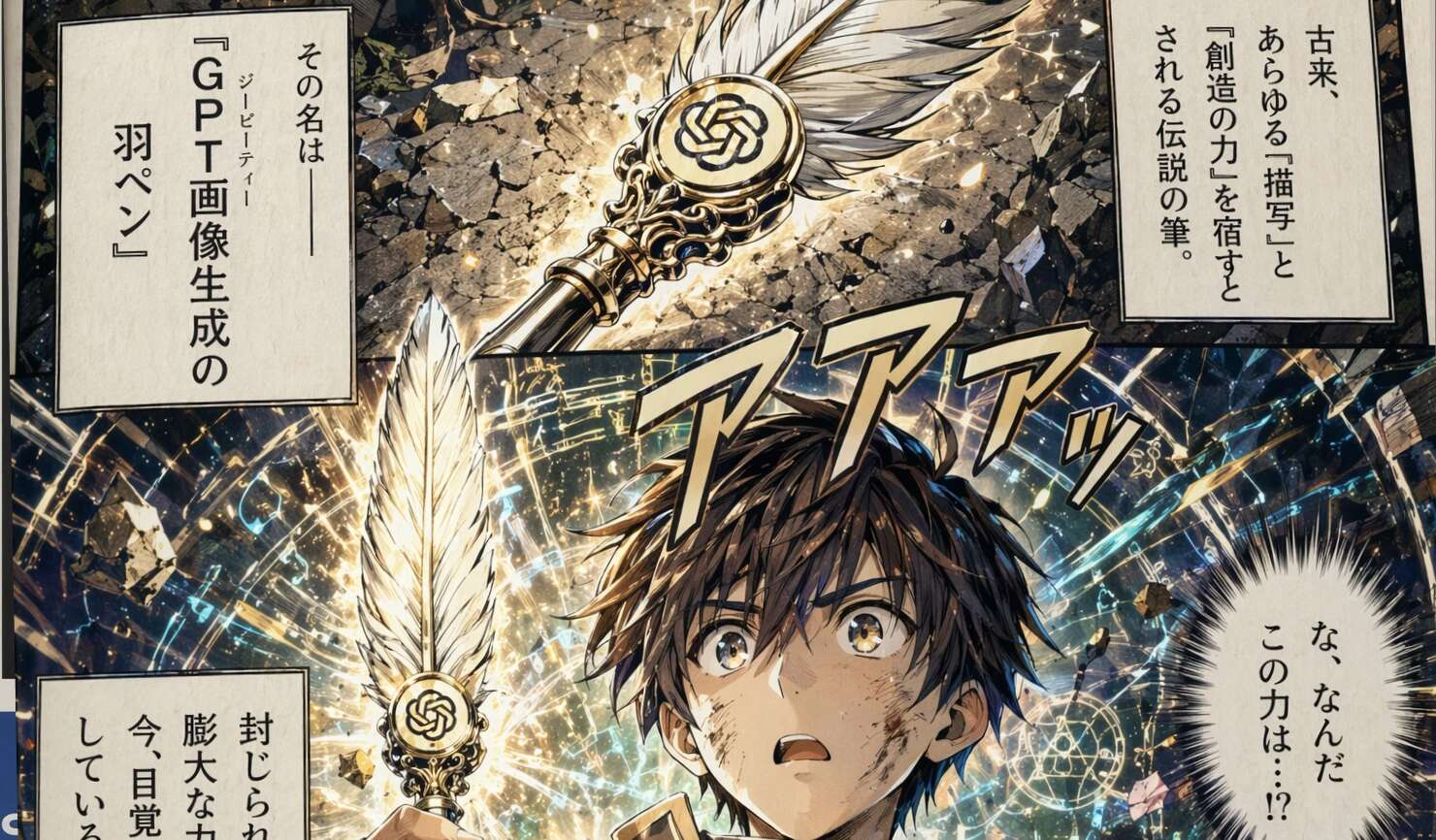

従来モデルの最大の弱点だった「文字が読めない」問題を中心に大幅に改善されており、テキスト描画精度は約99%に達したとされています(従来のgpt-image-1.5比で向上)。プレゼンスライド、マガジンレイアウト、インフォグラフィック、マンガといった「文字が主役のビジュアル制作」に初めて実用レベルで対応しました。

主な仕様は以下のとおりです。

- 解像度: 標準2K、APIベータで最大4K

- アスペクト比: 超横長(3:1)〜超縦長(1:3)まで対応

- 生成モード: 即時生成(Instant)/推論生成(Thinking)の2種類

- 最大同時生成数: 推論モードで1プロンプトにつき最大8枚(キャラクター・オブジェクトの一貫性を維持)

- ナレッジカットオフ: 2025年12月

最大の変化は「推論してから生成する」アーキテクチャ

ChatGPT Images 2.0最大の技術的前進は、OpenAIの「Oシリーズ」推論機能との統合です。モデルはレンダリング前にレイアウトや構成を内部で検討する処理を挟み、より指示に忠実な出力を目指します。さらにウェブ検索との連携によって、最新情報をもとに画像生成を行うことも可能になりました。

推論モード(Thinking)を使った高度な出力はChatGPT Plus・Pro・Businessユーザー向けで、無料ユーザーは即時生成(Instant)モードを利用できます。

また、従来モデル(gpt-image-1.5)はAPIでの後方互換アクセスを維持しつつ、デフォルトモデルの地位をgpt-image-2に引き継ぐかたちで段階的に廃止される見通しです。

日本語を含む多言語テキスト描画に対応

Images 2.0は「ポリグロットモデル」として設計されており、日本語・韓国語・中国語・ヒンディー語・ベンガル語など非ラテン系文字の高精度レンダリングに大幅な改善が施されています。

これはポスターや広告バナー、教育教材、SNSグラフィックなど、文字がデザインの一部として機能するコンテンツを制作する日本語ユーザーにとって直接的なメリットです。文字を後から手動修正する手間が大きく減ります。

API料金体系と利用条件

開発者向けAPIの料金は以下のとおりです。

| トークン種別 | 単価 |

|---|---|

| 画像入力トークン | $8 / 100万トークン |

| 画像出力トークン | $30 / 100万トークン |

| テキスト入力トークン | $5 / 100万トークン |

| テキスト出力トークン | $10 / 100万トークン |

1枚あたりの参考価格は約$0.006〜$0.211(解像度・品質設定に依存)。高解像度での生成では従来モデルより安価になるケースがあるとされています。APIへの正式提供は2026年5月初旬を予定しています。

Codex環境では、別途APIキーを用意しなくてもワークスペース内で直接画像生成が利用できます。

今後の注目点

OpenAIは「画像は言語であり装飾ではない」という立場を打ち出しており、画像生成をデザインツールやワークフローに組み込む方向性を明確にしました。競合のNano Banana Proが同様の「生成前推論」機能を搭載していることを踏まえると、2026年の画像生成市場は「推論×高精度テキスト」が競争の主軸になります。

今後の焦点は、4Kベータの安定化、推論モードの無料ユーザーへの段階的開放、そして動画生成モデルとの統合の可能性です。

編集部の見方

テキスト精度 99% の意味: 画像内テキスト描画精度 99%(2026年4月時点)は、看板・UI モック・チャート・スクリーンショット系の生成用途で「実用レベル」に到達したことを示します。日本語対応も明示された点は、国内マーケティング・SNS 投稿・教材制作に直接ハマる要素です。

推論モード搭載: 「考えてから生成する」推論モードは、複雑な構図やレイアウト指示を含むプロンプトで効果が大きく、画像 1 枚あたりの試行回数を減らせる可能性があります。一方でレイテンシは伸びるため、大量生成より少数高品質の用途に向きます。

無料開放と API 提供: 全ユーザー無料開放と gpt-image-2 API の両軸提供は、個人と企業の両方を一気に取りに行く戦略です。Stable Diffusion 系の自前運用や Midjourney との競争で、料金とアクセシビリティで先行する形になります。

よくある質問

Q: 無料ユーザーはChatGPT Images 2.0を使えますか?

A: はい、即時生成(Instant)モードで利用できます。推論モード(Thinking)を使った高度な出力はPlus・Pro・Businessプラン以上のユーザー向けです。

Q: 日本語テキストはどの程度正確に描画されますか?

A: OpenAIは日本語を含む非ラテン系文字の描画に大幅な改善を施したと発表しています。ただし具体的な日本語テキスト精度の数値は公式情報として確認できないため、実際の出力で検証することをおすすめします。

Q: 従来のgpt-image-1.5はどうなりますか?

A: APIでの後方互換アクセスは引き続き維持されますが、デフォルトモデルはgpt-image-2に切り替わります。段階的な廃止が予告されています。

まとめ

ChatGPT Images 2.0(gpt-image-2)は、テキスト描画精度の大幅向上・推論機能の統合・多言語対応という三点で、従来の「AI画像生成」から実務で使えるビジュアル制作ツールへの転換を目指しています。日本語ユーザーにとっても文字入り画像の制作ハードルが下がり、特に推論モードでの高度な出力やAPI活用を検討している場合は、5月初旬のAPI正式提供タイミングで実際の品質を確認するのが現実的です。

【用語解説】

- gpt-image-2【ジーピーティーイメージツー】: ChatGPT Images 2.0の基盤モデルのAPI名称。開発者はこのモデルIDを指定してAPIから画像生成を呼び出せます。

- Thinkingモード【シンキングモード】: 生成前に構成・レイアウトを内部で検討するOpenAIの推論機能。Oシリーズの推論技術を画像生成に応用したもの。Plus以上のプランで利用可能です。

- ポリグロットモデル: 複数の言語・文字体系に対応する多言語対応モデルを指す表現。Images 2.0では日本語・韓国語・中国語などの非ラテン系文字のレンダリング品質が向上しています。

免責事項: 本記事の情報は執筆時点のものです。AI技術は急速に進歩しているため、機能や制限は予告なく変更される場合があります。

引用元:

- [1] OpenAI – Introducing ChatGPT Images 2.0 – https://openai.com/index/introducing-chatgpt-images-2-0/

- [2] PetaPixel – OpenAI Claims ChatGPT Images 2.0 Can Think – https://petapixel.com/2026/04/21/openai-claims-chatgpt-images-2-0-can-think/

- [3] VentureBeat – OpenAI’s ChatGPT Images 2.0 multilingual support – https://venturebeat.com/technology/openais-chatgpt-images-2-0-is-here-and-it-does-multilingual-text-full-infographics-slides-maps-even-manga-seemingly-flawlessly

- [4] The Decoder – ChatGPT Images 2.0 thinks before it generates – https://the-decoder.com/openais-chatgpt-images-2-0-thinks-before-it-generates-adding-reasoning-and-web-search-to-image-creation/

この記事について: AI 支援で執筆、編集部が事実確認・編集しています。誤りや追加情報があれば Contact よりお知らせください。

Previous Post

Claude Code・Cowork – Codex 大型アップデートと比較した違い

Next Post

CursorがSpaceXと提携——xAI「Colossus」で独自モデルを強化、買収オプションも付与

15 年以上の開発経験を持つソフトウェアエンジニア / テクノロジーライター。AI エージェントの実務活用を研究し、現場や経営者向けセミナーでその知見を発信。本メディア tech-noisy.com では、一次情報に基づく最新ニュース・解説記事を執筆。また、音楽生成 AI による DJ パフォーマンスを企業イベントで行うなど、テクノロジーと表現の融合も探求している。